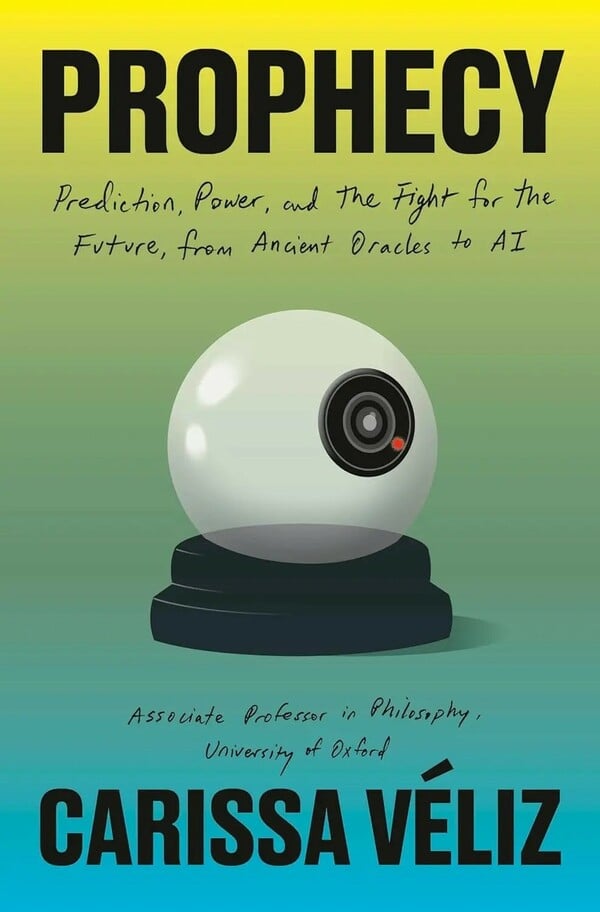

Το πρόβλημα με τα chatbots δεν είναι μόνο ότι κάνουν λάθη. Είναι ότι συχνά τα αντιμετωπίζουμε σαν να ξέρουν. Σαν να έχουν κάποια εσωτερική σχέση με την αλήθεια. Στην πραγματικότητα, όπως υποστηρίζει η φιλόσοφος Carissa Véliz στο νέο της βιβλίο Prophecy: Prediction, Power, and the Fight for the Future, From Ancient Oracles to AI, αυτό που κάνουν δεν είναι να γνωρίζουν. Είναι να προβλέπουν.

Η Véliz, φιλόσοφος στην Οξφόρδη και γνωστή για τη δουλειά της πάνω στην ιδιωτικότητα και την επιτήρηση, αντιμετωπίζει την τεχνητή νοημοσύνη όχι σαν μαγικό εργαλείο σκέψης, αλλά σαν την πιο πρόσφατη εκδοχή μιας πολύ παλιάς ανθρώπινης επιθυμίας: να μάθουμε τι θα συμβεί πριν συμβεί. Από τους αρχαίους μάντεις μέχρι την ασφάλιση, την ποσοτικοποίηση του ρίσκου, τους αλγόριθμους αξιολόγησης και τα μεγάλα γλωσσικά μοντέλα, το βιβλίο διαβάζει την πρόβλεψη ως μορφή εξουσίας.

Η κεντρική της θέση είναι καθαρή: τα μεγάλα γλωσσικά μοντέλα δεν είναι μηχανές αλήθειας. Είναι μηχανές πιθανοτήτων. Οταν ένα chatbot απαντά, δεν αναζητά την αλήθεια όπως θα την αναζητούσε ένας άνθρωπος, ένας ερευνητής ή ένας αναγνώστης που διασταυρώνει πηγές. Παράγει την απάντηση που μοιάζει πιο πιθανή, με βάση τα κείμενα, τα μοτίβα και την ανατροφοδότηση που έχει δεχτεί.

Αυτό εξηγεί γιατί η παραγωγική τεχνητή νοημοσύνη μπορεί να φαίνεται τόσο πειστική ακόμη και όταν κάνει λάθος. Δεν χρειάζεται να γνωρίζει τι είναι αλήθεια για να ακούγεται αληθοφανής. Και αυτή ακριβώς είναι η παγίδα. Το chatbot δεν είναι απαραίτητα ψεύτης. Είναι κάτι πιο ύπουλο για την εποχή μας: ένας εξαιρετικά ικανός μάντης του πιθανού.

Σε πρόσφατο κείμενό της στον Economist, η Véliz περιέγραψε την AI ως το νέο Μαντείο των Δελφών. Ο παραλληλισμός δεν είναι διακοσμητικός. Για τη φιλόσοφο, οι προβλέψεις δεν είναι ποτέ εντελώς αθώες. Οταν αφορούν ανθρώπους, δεν περιγράφουν απλώς το μέλλον. Συχνά το οργανώνουν.

Στο Prophecy, η Véliz δεν εστιάζει τόσο στα θεαματικά σενάρια καταστροφής που κυριαρχούν συχνά στη δημόσια συζήτηση για την AI. Δεν την ενδιαφέρουν πρωτίστως τα αυτόνομα φονικά ρομπότ ή οι φαντασιώσεις μιας μηχανής που θα καταστρέψει τον κόσμο από υπερβολική αυτονομία. Την απασχολούν οι πιο άμεσοι και πιο γήινοι κίνδυνοι: η επιτήρηση, η αλγοριθμική ταξινόμηση, η ενίσχυση αυταρχικών μηχανισμών, η μεταφορά του ρίσκου στους πιο αδύναμους.

Γιατί η πρόβλεψη δεν εξαφανίζει το ρίσκο. Συχνά απλώς το μεταφέρει. Οταν ένας αλγόριθμος αποφασίζει αν κάποιος θα πάρει δάνειο, αν θα νοικιάσει σπίτι, αν θεωρείται πιθανός παραβάτης ή αν μια ασφαλιστική εταιρεία θα καλύψει την απαίτησή του, το μέλλον δεν αποκαλύπτεται. Κατασκευάζεται ένα πλαίσιο μέσα στο οποίο κάποιοι άνθρωποι αντιμετωπίζονται ήδη σαν προβλήματα πριν προλάβουν να υπάρξουν ως περιπτώσεις.

Ακόμη πιο ανησυχητικό είναι ότι τέτοιες προβλέψεις μπορούν να γίνουν αυτοεκπληρούμενες. Αν ένα σύστημα κρίνει κάποιον μη απασχολήσιμο και πολλές εταιρείες χρησιμοποιούν παρόμοια εργαλεία, ο άνθρωπος αυτός μπορεί να μη βρει ποτέ δουλειά. Η πρόβλεψη θα μοιάζει τότε σωστή, όχι επειδή αποκάλυψε την αλήθεια, αλλά επειδή βοήθησε να δημιουργηθεί η πραγματικότητα που υποτίθεται ότι απλώς περιέγραφε.

Αυτό είναι το πολιτικό βάρος της πρόβλεψης. Οταν μια μηχανή προβλέπει το μέλλον ενός ανθρώπου, δεν κάνει μόνο μια τεχνική εκτίμηση. Ανοίγει ή κλείνει πόρτες. Μπορεί να καθορίσει ποιος θεωρείται αξιόπιστος, ποιος επικίνδυνος, ποιος ασφαλίσιμος, ποιος προσλήψιμος, ποιος άξιος πίστωσης, ποιος ύποπτος πριν ακόμη κάνει κάτι.

Εξίσου ενδιαφέρουσα είναι η πολιτισμική διάσταση του επιχειρήματος. Η Véliz βλέπει στην AI έναν κίνδυνο μονοκαλλιέργειας. Επειδή τα μοντέλα αυτά βασίζονται σε στατιστικές πιθανότητες, τείνουν προς τον μέσο όρο. Η γλώσσα χάνει την ιδιορρυθμία της. Οι προτάσεις γίνονται πιο ίδιες. Οι επιλογές πιο ομαλές. Οι συστάσεις πιο ασφαλείς. Ακόμη και η αισθητική, από τα κείμενα μέχρι τα καφέ που προτείνουν οι πλατφόρμες, αρχίζει να μοιάζει σαν να έχει περάσει από το ίδιο φίλτρο ευχάριστης ουδετερότητας.

Αυτό είναι ίσως το πιο ανησυχητικό σημείο για τον πολιτισμό. Η τεχνητή νοημοσύνη δεν απειλεί μόνο να αντικαταστήσει δουλειές ή να παράγει λάθος πληροφορίες. Απειλεί να κάνει τον κόσμο λίγο πιο ίδιο, λίγο πιο προβλέψιμο, λίγο πιο λείο. Να εξαφανίσει όχι την εξυπνάδα, αλλά την παραφωνία. Ομως χωρίς παραφωνία δεν υπάρχει πραγματική σκέψη. Υπάρχει μόνο καλή διαχείριση του μέσου όρου.

Το βιβλίο της Véliz είναι, τελικά, και ένα βιβλίο για την ανισότητα. Η Big Tech συγκεντρώνει τεράστια δύναμη επειδή υπόσχεται ότι μπορεί να προβλέψει συμπεριφορές, κινδύνους, επιθυμίες, καταναλωτικές αποφάσεις, πολιτικές τάσεις. Οι απλοί άνθρωποι καλούνται να ζήσουν μέσα σε συστήματα που τους βαθμολογούν, τους κατευθύνουν ή τους αποκλείουν, ενώ οι πολύ πλούσιοι επενδύουν σε κέντρα δεδομένων, μηχανισμούς επιρροής και φαντασιώσεις διαφυγής από τον κόσμο που οι ίδιοι βοηθούν να γίνει πιο εύθραυστος.

Απέναντι σε αυτή τη λατρεία της πρόβλεψης, η Véliz προτείνει κάτι σχεδόν παλιομοδίτικο: περισσότερη δέσμευση στο παρόν, περισσότερη φιλοσοφία, περισσότερη περιέργεια, περισσότερη αντοχή στην αβεβαιότητα. Γιατί η αβεβαιότητα δεν είναι μόνο απειλή. Είναι και ο χώρος όπου μπορεί ακόμη να υπάρξει ελευθερία.

Το Prophecy μοιάζει να λέει ότι η εποχή μας δεν χρειάζεται άλλους μάντεις. Χρειάζεται καλύτερους τρόπους να ζει χωρίς την ψευδαίσθηση ότι όλα μπορούν να προβλεφθούν. Το chatbot μπορεί να συμπληρώνει το επόμενο πιθανό κομμάτι της πρότασης. Αλλά η αλήθεια, η κρίση, η φαντασία και η ευθύνη παραμένουν ανθρώπινη δουλειά.

Με στοιχεία από The New York Times και The Economist.